La plupart des guides d’extraction de données LinkedIn finissent pareil : « utilise un outil avec une API, importe ton fichier, attends que les crédits descendent ». Ce modèle suppose que vous travaillez dans un dashboard ou un Sheet. En 2026, de plus en plus de prospection se passe à l’intérieur d’un assistant IA, Claude Desktop, ChatGPT, Cursor, et le standard pour qu’une IA appelle des outils externes s’appelle le Model Context Protocol (MCP).

Un scraper LinkedIn MCP, c’est le pont : l’assistant IA devient l’opérateur, et une tâche d’extraction LinkedIn devient une simple phrase dans un chat. « Donne-moi le headline et l’entreprise actuelle pour ces 20 URLs LinkedIn. » « Trouve le head of sales dans ces 30 entreprises et renvoie leurs URLs LinkedIn. » Pas de barre latérale, pas de copier-coller, pas de dashboard à part.

Ce guide explique ce qu’est concrètement un scraper LinkedIn MCP, les trois familles que vous croiserez en 2026 (browser-automation, API officielle, enrichissement natif), comment en configurer un avec Claude Desktop, ce que dit la CGU LinkedIn sur chaque approche, et un workflow SDR réaliste à la fin.

Chapitre 1 : Qu’est-ce qu’un MCP, en un paragraphe

Le Model Context Protocol est un standard ouvert publié fin 2024 qui définit une façon structurée pour un assistant IA d’appeler des outils externes. Voyez-le comme la prise USB-C de l’outillage IA : au lieu que chaque assistant invente sa propre syntaxe d’appel d’outil, MCP leur donne un format partagé. Un serveur MCP expose une liste d’outils (les fonctions que l’IA peut appeler), un client MCP (Claude Desktop, ChatGPT, Cursor, Cline, Windsurf) lit cette liste et permet au modèle de les invoquer à la demande.

Un scraper LinkedIn MCP est simplement un serveur MCP dont les outils extraient des données LinkedIn. Ce n’est pas une nouvelle pile technique. C’est la même logique de scraping ou d’enrichissement que vous exposeriez sous forme de script Python ou d’API REST, packagée pour qu’un assistant IA puisse l’appeler sans wrapper.

Pour la vue d’ensemble sur les méthodes d’extraction LinkedIn (scrapers, APIs, enrichissement natif), le guide 2026 de l’extraction de données LinkedIn couvre les quatre familles et comment choisir. Cet article zoome sur la variante MCP.

Chapitre 2 : Les trois familles de scraper LinkedIn MCP en 2026

Tous les serveurs MCP étiquetés « linkedin scraper » ne font pas la même chose. L’étiquette cache trois approches techniques très différentes, avec des profils de risque et de qualité très différents.

Famille 1 : MCP en automatisation navigateur

Ils embarquent un navigateur headless (Playwright, Patchright, Selenium) qui se connecte à LinkedIn avec un compte réel et scrape les pages de profil à la demande. Le serveur MCP démarre le navigateur, navigue vers une URL de profil et renvoie les champs parsés.

Exemples : stickerdaniel/linkedin-mcp-server, linkedin-scraper-mcp sur PyPI (sorti en avril 2026), plusieurs variantes communautaires Apify et Lobehub.

Forces :

- Lit tout ce que l’utilisateur peut voir sur une page de profil

- Fonctionne avec les vues Sales Navigator

- Aucune dépendance à un fournisseur de données tiers

Faiblesses :

- Demande à l’utilisateur d’exposer son cookie ou sa session LinkedIn au serveur MCP. Ce cookie équivaut à un accès au compte.

- LinkedIn rate-limit agressivement. Un compte standard est flaggé après environ 80 à 100 vues de profils par jour.

- LinkedIn a serré la vis sur le scraping basé Playwright fin 2025 ; les serveurs ont dû migrer vers Patchright (un fork de Playwright conçu pour passer la détection de bots). Le jeu du chat et de la souris continue trimestre après trimestre.

- L’article 8.2 des CGU LinkedIn interdit « l’accès automatisé » au service. Les MCP en browser-automation tombent en plein dedans.

Pour qui : développeurs qui acceptent déjà les compromis d’un scraper LinkedIn personnel et veulent déplacer ce workflow dans Claude Desktop plutôt qu’un REPL Python.

Famille 2 : MCP basés sur l’API officielle

Ils appellent les endpoints de l’API officielle LinkedIn (Marketing Developer Platform, Sales Navigator API, Talent Solutions). Le serveur MCP est juste un wrapper fin autour des endpoints partenaires documentés.

Forces :

- Pleinement conforme aux CGU LinkedIn.

- Aucun risque de flag de compte.

- Rate limits stables, comportement documenté.

Faiblesses :

- Nécessite une approbation partenaire LinkedIn. Le processus prend des semaines et le rejet est fréquent pour les cas d’usage ambigus.

- Les données de profil pour la prospection à froid ne sont pas au menu. L’API officielle expose des données ad-tech, des intégrations ATS et des champs limités de Sales Navigator, mais pas le fetch de profils que la prospection attend.

- Même l’accès API Sales Navigator est gated derrière des contrats enterprise.

Pour qui : entreprises qui construisent des intégrations que LinkedIn validerait volontiers (un ATS, une plateforme ad-tech, une sync bidirectionnelle CRM partenaire). Pas adapté à un SDR qui doit enrichir une liste de prospects froids.

Famille 3 : MCP en enrichissement natif

Ils ne se connectent pas du tout à LinkedIn. Le serveur MCP prend une URL LinkedIn, un nom + entreprise ou un email en entrée, puis lance une cascade de sources publiques, bases opt-in et fournisseurs de vérification détenus par le vendor de données. Les données sont « LinkedIn-style » mais sourcées en dehors de LinkedIn.

Exemples : Derrick MCP sur https://app1.derrick-app.com/mcp, et quelques endpoints MCP plus petits apparus en 2026.

Forces :

- Aucun cookie LinkedIn confié à un tiers.

- Aucun risque de flag de compte.

- Coût en crédits déterministe ; les recherches infructueuses ne consomment généralement pas de crédits quand la source le permet.

- Même backbone de données que l’API du vendor, son extension Chrome et son add-on Sheets (donc l’assistant IA obtient la même qualité d’enrichissement que celle déjà validée par l’équipe).

Faiblesses :

- La couverture dépend des partenariats data du vendor. La couverture US enterprise est généralement profonde ; le mid-market européen est parfois moins fourni.

- Certains champs de niche (appartenance à un groupe LinkedIn, filtres Sales Navigator spécifiques) ne sont pas toujours couverts.

Pour qui : SDRs, recruteurs, growth marketers et fondateurs qui veulent extraire des données LinkedIn dans Claude Desktop ou ChatGPT sans monter un scraper ni postuler au programme partenaire. C’est la voie la moins friction des trois.

Chapitre 3 : Configurer un scraper LinkedIn MCP avec Claude Desktop

Le pattern de mise en place est le même pour les trois familles : éditer claude_desktop_config.json, ajouter une entrée sous mcpServers, redémarrer Claude Desktop. Là où ça diffère, c’est le binaire pointé et les credentials passés.

Le pattern partagé

Sur macOS, le fichier vit à ~/Library/Application Support/Claude/claude_desktop_config.json. Sur Windows, à %APPDATA%\Claude\claude_desktop_config.json. S’il n’existe pas, créez-le.

Le fichier ressemble à ça :

{

"mcpServers": {

"linkedin": {

"command": "node",

"args": ["/chemin/vers/server.js"],

"env": {

"API_KEY": "votre-cle-ici"

}

}

}

}Après édition, quittez complètement Claude Desktop et rouvrez-le. Le serveur MCP apparaît en bas à droite de la zone de chat sous forme d’indicateur d’outils. Sinon, vérifiez les logs dans ~/Library/Logs/Claude/mcp-server-linkedin.log.

Configuration pour un MCP en automatisation navigateur

Les serveurs publiés sur npm ou pip veulent en général un répertoire utilisateur Chrome et un cookie de session LinkedIn :

{

"mcpServers": {

"linkedin-scraper": {

"command": "npx",

"args": ["-y", "linkedin-mcp-server@latest"],

"env": {

"LINKEDIN_COOKIE": "li_at=AQED...",

"USER_DATA_DIR": "/Users/vous/Library/Application Support/Patchright/Default"

}

}

}

}Vous devrez extraire le cookie li_at manuellement depuis les outils de dev de votre navigateur. Traitez cette chaîne comme un mot de passe ; quiconque l’a peut agir comme vous sur LinkedIn.

Configuration pour un MCP basé API

Ils demandent les credentials OAuth délivrés par LinkedIn après approbation partenaire :

{

"mcpServers": {

"linkedin-api": {

"command": "node",

"args": ["/usr/local/bin/linkedin-api-mcp.js"],

"env": {

"LINKEDIN_CLIENT_ID": "...",

"LINKEDIN_CLIENT_SECRET": "...",

"LINKEDIN_ACCESS_TOKEN": "..."

}

}

}

}Le flow d’application passe par https://www.linkedin.com/developers/. Prévoyez 2 à 6 semaines d’attente.

Configuration pour un MCP en enrichissement natif (exemple Derrick)

Un MCP hébergé chez le vendor expose un endpoint HTTPS et une clé API. Pas de binaire local, pas de cookie navigateur.

{

"mcpServers": {

"derrick": {

"type": "http",

"url": "https://app1.derrick-app.com/mcp",

"headers": {

"Authorization": "Bearer VOTRE_CLE_API_DERRICK"

}

}

}

}La clé API se génère depuis le dashboard Derrick une fois sur le plan Standard (20 €/mois minimum). Le MCP expose les mêmes outils d’enrichissement que la sidebar Sheets : enrichissement de profil, enrichissement d’entreprise, email finder, phone finder, recherche d’URL LinkedIn, et quelques autres. Après le redémarrage, demander à Claude « trouve l’URL LinkedIn de Jean Dupont chez Acme » route automatiquement par le MCP.

Référence →Le guide 2026 de l'extraction de données LinkedIn

Quatre méthodes côte à côte : scrapers, APIs, enrichissement natif, MCP. Choisissez la bonne pour votre équipe.

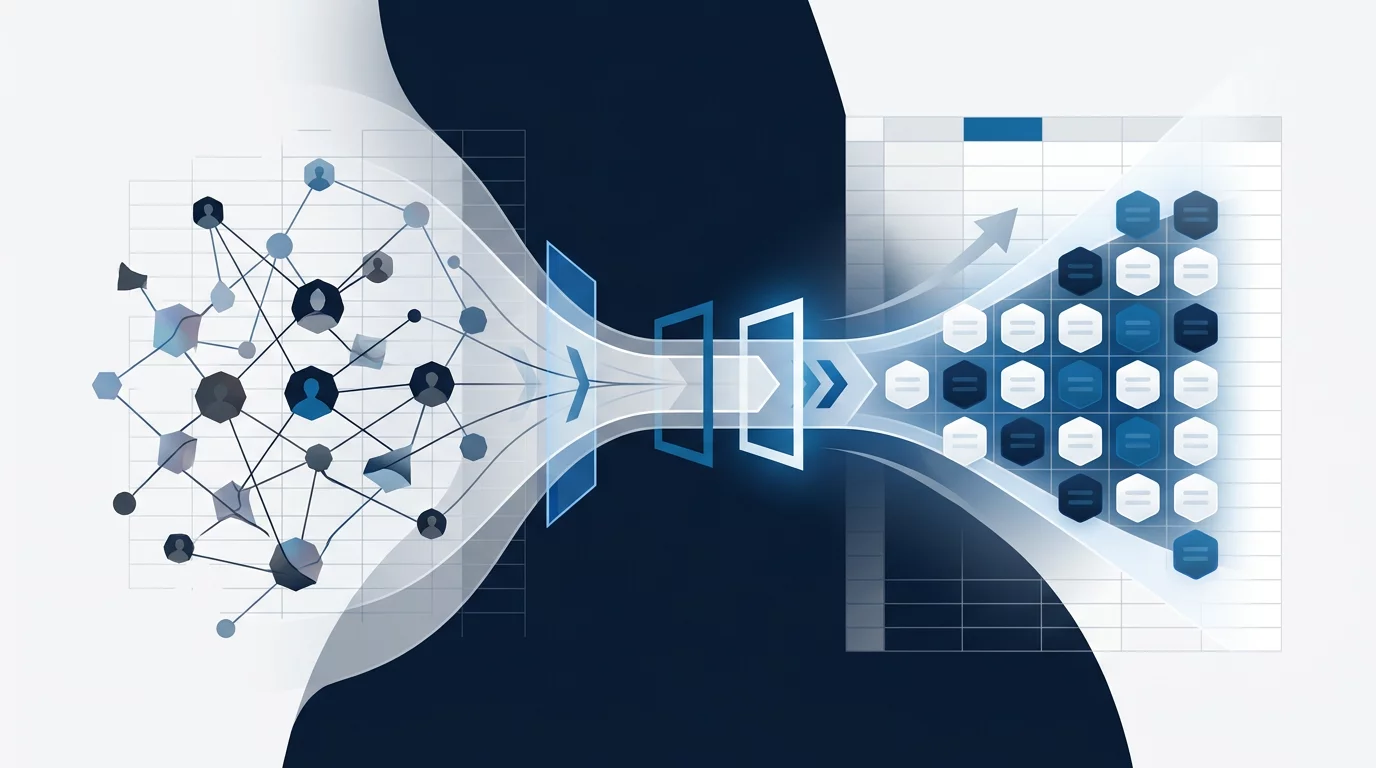

Chapitre 4 : Les outils que vous obtenez vraiment

À travers les trois familles, un scraper LinkedIn MCP typique expose une surface d’outils similaire. Les noms varient ; la capacité sous-jacente est la même.

| Outil | Ce qu’il fait | Browser-automation | API officielle | Enrichissement natif |

|---|---|---|---|---|

get_profile |

Récupère les champs d’un profil depuis une URL LinkedIn | Oui | Limité | Oui |

get_company |

Récupère les champs d’une entreprise | Oui | Oui | Oui |

find_profile_by_name |

Résout nom + entreprise vers une URL LinkedIn | Oui | Limité | Oui |

find_email |

Recherche email best-effort depuis une URL | Non | Non | Oui |

find_phone |

Recherche téléphone best-effort | Non | Non | Oui |

search_companies |

Trouve des URLs d’entreprise par nom | Oui | Oui | Oui |

list_employees |

Récupère les employés d’une entreprise | Oui (Sales Nav) | Non | Partiel |

get_jobs |

Récupère les offres ouvertes | Oui | Oui | Partiel |

Un workflow de prospection réel chaîne plusieurs de ces outils. C’est ce qui rend l’assistant IA utile : il compose les appels d’outils au lieu que vous ouvriez sept onglets.

Chapitre 5 : Un workflow SDR concret dans Claude Desktop

Voici le pattern qui justifie le travail de configuration. Le SDR prépare une séquence pour lundi matin. Il a une liste de 30 entreprises cibles dans un Google Sheet et il lui faut les URLs LinkedIn des décideurs, leurs headlines et leurs emails avant mardi.

Dans Claude Desktop, avec un MCP d’enrichissement natif connecté, la conversation ressemble à ça :

Utilisateur : J’ai 30 entreprises dans ce sheet [colle la liste]. Trouve le head of sales dans chacune. Renvoie URL LinkedIn, headline, entreprise actuelle et email si disponible.

Claude appelle search_companies pour chaque nom d’entreprise pour confirmer l’URL LinkedIn. Puis find_profile_by_name avec des variantes de poste (« Head of Sales », « VP Sales », « Sales Director », « Directeur Commercial »). Puis find_email sur chaque URL de profil qui a remonté un hit. Résultat : un tableau markdown dans le chat avec 25-30 lignes, prêt à être collé dans le Sheet.

Temps écoulé : environ 4 minutes pour 30 entreprises. Le même workflow en manuel, en ouvrant des onglets de recherche LinkedIn, prend 90 minutes ou plus.

Le coût en crédits sur un MCP d’enrichissement natif pour ce run : environ 30 lookups d’URL LinkedIn (1 crédit chacun) + 30 enrichissements de profil (1 crédit chacun) + 25 lookups d’email (5 crédits par trouvé, donc ~75-100 crédits si le hit rate est de 60-70 %). Total : ~165-180 crédits. Le plan Standard (20 €/mois) embarque 10 000 crédits, donc ce workflow consomme environ 2 % du budget mensuel.

Le même workflow sur un MCP en browser-automation oblige le SDR à garder son compte LinkedIn en bon état, paginer prudemment pour éviter les rate limits, et surveiller les warnings « activité inhabituelle détectée ». Le même workflow sur un MCP API officielle est tout simplement impossible parce que le lookup de profil à froid ne fait partie d’aucun programme partenaire.

Pour aller plus loin sur Sales Navigator, le guide Sales Navigator gratuit explique comment combiner la recherche en plan gratuit et l’enrichissement.

Chapitre 6 : Le contexte légal et opérationnel

Trois points à lire avec attention avant de pousser un scraper LinkedIn MCP dans un workflow d’équipe en production.

Article 8.2 des CGU LinkedIn

Les CGU LinkedIn interdisent explicitement « le scraping, la copie ou l’accès automatisé » au service. La clause est en place depuis 2014 et sert de base à la jurisprudence hiQ Labs v. LinkedIn (Ninth Circuit, 2017-2022). Les MCP en browser-automation violent cette clause peu importe le soin apporté au rate limiting.

Les MCP basés API officielle sont exemptés parce qu’ils appellent des endpoints partenaires documentés. Les MCP en enrichissement natif sortent complètement de la conversation CGU LinkedIn parce qu’ils n’accèdent pas directement à LinkedIn ; ils interrogent des sources de données indépendantes qui agrègent de la donnée B2B depuis des sources publiques, des bases opt-in et des partenariats.

RGPD et base légale

Dans l’UE, même un scraping conforme aux CGU n’épuise pas la question juridique. Le traitement de données personnelles requiert une base légale (intérêt légitime, contrat, consentement). Pour la prospection B2B, « l’intérêt légitime » est généralement défendable si vous avez un mécanisme d’opt-out clair, une politique de rétention et un argument de proportionnalité. Pour des flows grand public, la barre est nettement plus haute. Faites valider par un avocat data avant de monter en volume.

Pour creuser le sujet, le guide RGPD de l’enrichissement de données déroule la base légale pour les équipes B2B.

Sécurité du compte en pratique

Si vous décidez de faire tourner un MCP en browser-automation, trois habitudes réduisent significativement le risque de flag :

- Utilisez un compte LinkedIn dédié, pas votre compte personnel.

- Cappez le serveur MCP à 50 fetches de profils par jour.

- Ajoutez un délai aléatoire de 30 à 60 secondes entre chaque fetch.

Ces mitigations ralentissent suffisamment le workflow pour que, dans la plupart des équipes, la voie de l’enrichissement natif finisse par être plus rentable, même avant de compter le risque légal.

Chapitre 7 : Comment choisir

Un arbre de décision rapide qui mappe les trois familles aux profils d’équipe courants.

Choisir un MCP en browser-automation si : vous avez de la capacité d’ingénierie, vous acceptez le risque CGU LinkedIn, vous avez un compte dédié remplaçable à coût faible, et vos besoins data incluent des champs qu’aucune API ni aucun vendor n’expose (résultats de recherche Sales Navigator complets, appartenance à des groupes, signaux de niche).

Choisir un MCP basé API si : vous construisez une intégration que LinkedIn validerait (ATS, ad-tech, sync CRM partenaire). Prévoyez le processus partenaire. Ne choisissez pas cette voie si votre objectif est l’enrichissement de prospects froids.

Choisir un MCP en enrichissement natif si : vous voulez de l’extraction LinkedIn dans Claude Desktop ou ChatGPT aujourd’hui, sans setup au-delà de coller une clé API, sans risque de flag de compte LinkedIn, et avec un pricing prévisible en crédits. Ça couvre les use cases SDR, recruteur, growth marketer et fondateur.

Pour la plupart des équipes en 2026, la voie de l’enrichissement natif est celle qui ship en 10 minutes et reste opérationnelle. La voie browser-automation occupe les ingénieurs. La voie API officielle apparaît en board meeting et rarement en prod prospection.

À retenir

- Un scraper LinkedIn MCP est un serveur MCP dont les outils extraient des données LinkedIn ; l’assistant IA devient l’opérateur.

- Trois familles en 2026 : browser-automation (flexible, CGU-violante, risque compte), API officielle (compliante mais étroite), enrichissement natif (friction minimale, sources vendor).

- La configuration tient en une entrée JSON dans

claude_desktop_config.jsonplus un redémarrage. - L’enrichissement natif est la voie la moins friction pour SDRs, recruteurs et équipes growth.

- L’article 8.2 des CGU LinkedIn s’applique toujours au browser-automation ; le RGPD ajoute une couche en UE.

FAQ

Quelle est la différence entre un scraper LinkedIn et un MCP LinkedIn ?

Un scraper est la logique sous-jacente qui extrait les données. Un MCP est le protocole qui permet à un assistant IA d’appeler cette logique comme un outil. Vous pouvez avoir un scraper sans MCP (un script Python lancé à la main). Vous pouvez aussi avoir un MCP sans scraper (un MCP d’enrichissement natif qui appelle des APIs tierces au lieu de scraper). Les deux sont indépendants.

Faut-il un compte LinkedIn pour utiliser un MCP LinkedIn ?

Pour les MCP en browser-automation, oui ; il faut un compte LinkedIn fonctionnel et exposer le cookie de session au serveur. Pour les MCP API officielle, il faut des credentials partenaires. Pour les MCP en enrichissement natif, vous n’avez pas strictement besoin de vous connecter pour que le MCP lui-même tourne, mais le workflow démarre généralement sur des URLs LinkedIn que l’utilisateur a collectées en naviguant LinkedIn, ce qui requiert un compte LinkedIn en pratique. Méfiez-vous des vendors qui revendiquent « pas besoin de compte LinkedIn » ; c’est rarement littéralement vrai.

Utiliser un scraper LinkedIn MCP, c’est légal ?

Ça dépend de la famille. Les MCP en browser-automation violent les CGU LinkedIn. Les MCP basés API officielle sont compliants si vous êtes partenaire approuvé. Les MCP en enrichissement natif sortent de la conversation CGU LinkedIn mais doivent toujours respecter le RGPD, le CCPA et les autres régimes de protection des données. Faites valider par un avocat avant de monter en volume.

Combien coûte un MCP LinkedIn ?

Les MCP open-source en browser-automation sont gratuits côté logiciel mais coûtent le prix d’un compte LinkedIn s’il est banni, plus le temps d’ingénierie de maintenance. Les MCP API officielle requièrent un contrat partenaire enterprise. Les MCP en enrichissement natif facturent au crédit ; les tiers d’entrée sont entre 9 et 20 €/mois pour 4 000 à 10 000 crédits, ce qui couvre des milliers de lookups de profils.

Mon compte LinkedIn risque-t-il un ban si j’utilise un scraper MCP ?

Si vous utilisez un MCP en browser-automation à volume soutenu (plus de 80 à 100 vues de profil par jour depuis un compte), oui, le risque est réel. Si vous restez sous ce plafond avec des délais aléatoires, le risque pratique se rapproche d’un comportement de navigation manuelle. Les MCP API officielle et enrichissement natif ne touchent pas votre compte LinkedIn.

Puis-je utiliser plusieurs MCP LinkedIn simultanément dans Claude Desktop ?

Oui. Claude Desktop charge tous les serveurs MCP listés dans la config et expose leurs outils au modèle. Vous pouvez combiner par exemple un MCP d’enrichissement natif pour le workflow de prospection quotidien et un MCP de recherche distinct pour des lectures de profil de type recherche académique. Le modèle pioche le bon outil par son nom.

Quel est le meilleur serveur MCP LinkedIn pour 2026 ?

Ça dépend du use case. Pour des workflows de prospection compliants dans Claude Desktop ou ChatGPT sans mise en place, les MCP en enrichissement natif (Derrick MCP, autres) sont les moins friction. Pour les développeurs qui veulent lire tout ce qui est visible sur un profil et qui acceptent les compromis, les serveurs open-source en browser-automation (stickerdaniel/linkedin-mcp-server, linkedin-scraper-mcp sur PyPI) sont les plus activement maintenus à la mi-2026. Il n’existe pas de serveur MCP officiel publié par LinkedIn.